Microsoftがコスト効率の高い小さめの言語モデル「Phi-3」をリリース、オープンモデルで商用利用可能

Microsoftが小さい規模で大きな性能を発揮する言語モデルとして「Phi-3」ファミリーをリリースしました。ファミリーの中でも一番小さなサイズのモデルであるPhi-3-miniはオープンモデルとなっており、無料で商用利用が可能です。

Introducing Phi-3: Redefining what's possible with SLMs | Microsoft Azure Blog

https://azure.microsoft.com/en-us/blog/introducing-phi-3-redefining-whats-possible-with-slms/

Tiny but mighty: The Phi-3 small language models with big potential - Source

https://news.microsoft.com/source/features/ai/the-phi-3-small-language-models-with-big-potential/

[2404.14219] Phi-3 Technical Report: A Highly Capable Language Model Locally on Your Phone

https://arxiv.org/abs/2404.14219

2023年12月に前のモデル「Phi-2」をリリースした時の記事は下記の通り。Phi-2の時点で最大25倍サイズのモデルと同等以上の性能を発揮できるとされていました。

Microsoftが小規模言語モデル「Phi-2」をリリース、小規模なのに最大25倍サイズのモデルと同等以上の性能 - GIGAZINE

今回は「Phi-3」モデルファミリーの発表と同時にPhi-3ファミリーのうち一番小さなサイズのモデルである38億(3.8B)パラメーターの「Phi-3-mini」がリリースされ、Azure AIモデルカタログで利用可能になりました。Phi-3ファミリーには他に70億(7B)パラメーターの「Phi-3-small」と140億(14B)パラメーターの「Phi-3-medium」が存在しており、この2つのモデルについては近いうちにAzure AIモデルカタログにて利用可能になる予定とされています。

言語モデルはパラメーターの数が多い大規模なモデルほど高度な推論やデータ分析、コンテキストの理解など複雑なタスクをうまくこなせる傾向にありますが、一方でモデルのパラメーター数が多くなるほどトレーニングと推論の両方において必要なコンピューティングパワーが増加していきます。

Phi-3のような小さめのモデルでは必要なコンピューティングパワーが少ないためコストを低く抑えられるほか、ファインチューニングなどによるカスタマイズを容易に行えたり、デバイス上でローカルに実行したり素早い応答を実現したりすることが可能。パラメーター数を減らしつついかに性能を維持するかが大切というわけです。

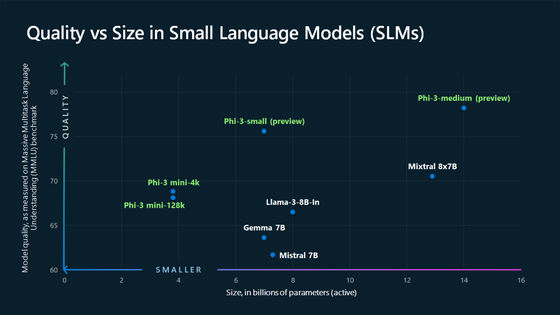

Mixtral 8x7BやLlama 3 8B、Gemma 7B、Mistral 7Bなどオープンなモデルとの比較は下図の通り。縦軸が性能、横軸がサイズを表しており、左上に行くほど小さいサイズで高いパフォーマンスを出せる優れたモデルということを示しています。Phi-3ファミリーのモデルは「品質とコストのトレードオフ曲線」を新たな位置まで押し上げることに成功したと言えそうです。

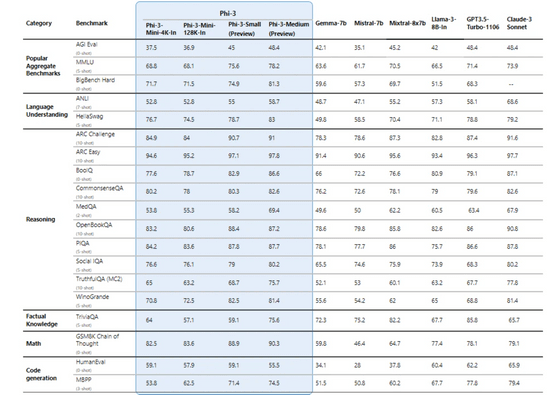

それぞれのモデルの具体的なベンチマークの結果は下図の通り。Phi-3のいずれのモデルも自身より大きいサイズのモデルに勝てる性能を発揮していると言えますが、モデルサイズが小さいことで事実を記憶できる容量が減り、TriviaQAなど事実知識を計測するベンチマークではあまり結果が良くありません。

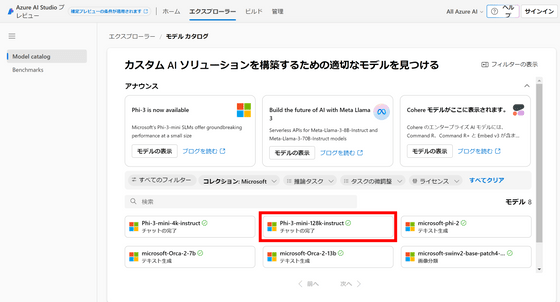

発表と同時にリリースされた「Phi-3-mini」はMITライセンスで提供されており、Azure AIモデルカタログのほか、Hugging FaceとOllamaで利用可能になっています。

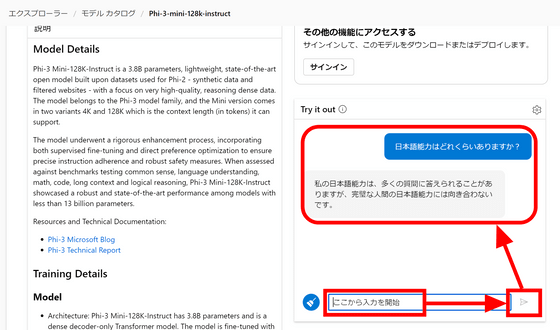

Azure AIモデルカタログではPhi-3-miniの動作を実際に確認できます。サイトにアクセスすると下部にAIモデルが表示されるので、「Phi-3-mini-128k-instruct」をクリック。

右下のチャット欄にプロンプトを入力して紙飛行機のマークをクリックすればPhi-3-miniが応答してくれます。「日本語能力はどれくらいありますか?」と聞いてみるとやや不自然ながらも日本語で回答してくれました。

・関連記事

無料で商用利用可能なオープンモデル「Mixtral 8x22B」が登場、高いコーディングと数学の能力を持つ - GIGAZINE

Googleがオープンかつ商用利用可能で軽量な大規模言語モデル「Gemma」を公開 - GIGAZINE

Metaが次世代のオープンLLM「Llama 3」を公開、無料で商用利用可能なモデルの中では過去最高の性能 - GIGAZINE

Databricksがオープンな大規模言語モデル「DBRX」をリリース、GPT-3.5やCodeLLaMA-70Bを上回る性能 - GIGAZINE

高解像度のAI画像を0.5秒で吐き出すオープンソースの画像生成モデル「PixArt-δ」が登場 - GIGAZINE

・関連コンテンツ